df=read_sav("datos/coolKids.sav", user_na=FALSE) %>% haven::as_factor() 6 Independencia de variables categóricas

Las tablas de contingencia se utilizan para examinar la relación entre dos variables categóricas, o bien explorar la distribución que posee una variable categórica entre diferentes muestras.

Hay diferentes cuestiones que surgen al examinar una tabla de contingencia, y en este tema vamos a tratar la cuestión de la independencia.

La independencia de dos variables consiste en que la distribución de una de las variables es similar sea cual sea el nivel que examinemos de la otra. Esto se traduce en una tabla de contingencia en que las frecuencias de las filas (y las columnas) son aproximadamente proporcionales. Esto es equivalente a observar que los porcentajes por columnas(o filas) son similares.

La prueba de independencia \(\chi^2\) (chi-cuadrado) contrasta la hipótesis de que las variables son independientes, frente a la hipótesis alternativa de que una variable se distribuye de modo diferente para diversos niveles de la otra.

Ejemplo:Prioridades en niños y sexo

Vamos a usar la base de datos coolKids.sav donde se recogen las respuestas de unos escolares de 10 a 12 años a los que se les preguntó, entre otras cosas, a qué daban más prioridad de entre tres posibilidades: Tener buenas notas, destacar en los deportes o ser popular entre los compañeros. Examinemos las primeras líneas de la base de datos:

df %>% head() %>% knitr::kable(booktabs=T)| Sexo | Curso | Edad | Raza | Entorno | Escuela | Metas | Notas | Deportes | Apariencia | Dinero |

|---|---|---|---|---|---|---|---|---|---|---|

| Varón | 5 | 11 | Blanco | Rural | Elm | Deportes | 1 | 2 | 4 | 3 |

| Varón | 5 | 10 | Blanco | Rural | Elm | Popular | 2 | 1 | 4 | 3 |

| Mujer | 5 | 11 | Blanco | Rural | Elm | Popular | 4 | 3 | 1 | 2 |

| Mujer | 5 | 11 | Blanco | Rural | Elm | Popular | 2 | 3 | 4 | 1 |

| Mujer | 5 | 10 | Blanco | Rural | Elm | Popular | 4 | 2 | 1 | 3 |

| Mujer | 5 | 11 | Blanco | Rural | Elm | Popular | 4 | 2 | 1 | 3 |

Vamos a estudiar por sexos si por sexo hay diferencias en la distribución de las metas:

df <- df %>%

mutate(Sexo = factor(Sexo))

tabla_cuali_chi <- df %>%

select(all_of(c("Sexo", "Metas"))) %>%

tbl_summary(

by = Sexo,

type = all_categorical() ~ "categorical",

statistic = all_categorical() ~ "{n} ({p}%)",

missing = "ifany"

) %>%

add_p(

test = all_categorical() ~ "chisq.test",

pvalue_fun = ~ style_pvalue(.x, digits = 3)

) %>%

modify_header(label ~ "**Variable**") %>%

bold_labels()

tabla_cuali_chi| Variable | Varón N = 2271 |

Mujer N = 2511 |

p-value2 |

|---|---|---|---|

| Metas | <0.001 | ||

| Notas | 117 (52%) | 130 (52%) | |

| Popular | 50 (22%) | 91 (36%) | |

| Deportes | 60 (26%) | 30 (12%) | |

| 1 n (%) | |||

| 2 Pearson’s Chi-squared test | |||

La significación que se observa en la tabla (p), es la de la prueba Chi-cuadrado. Nos indica que las diferencias en porcentajes que se aprecian en las columnas de niños y niñas van más allá de lo que se esperaría que ocurriese por puro azar.

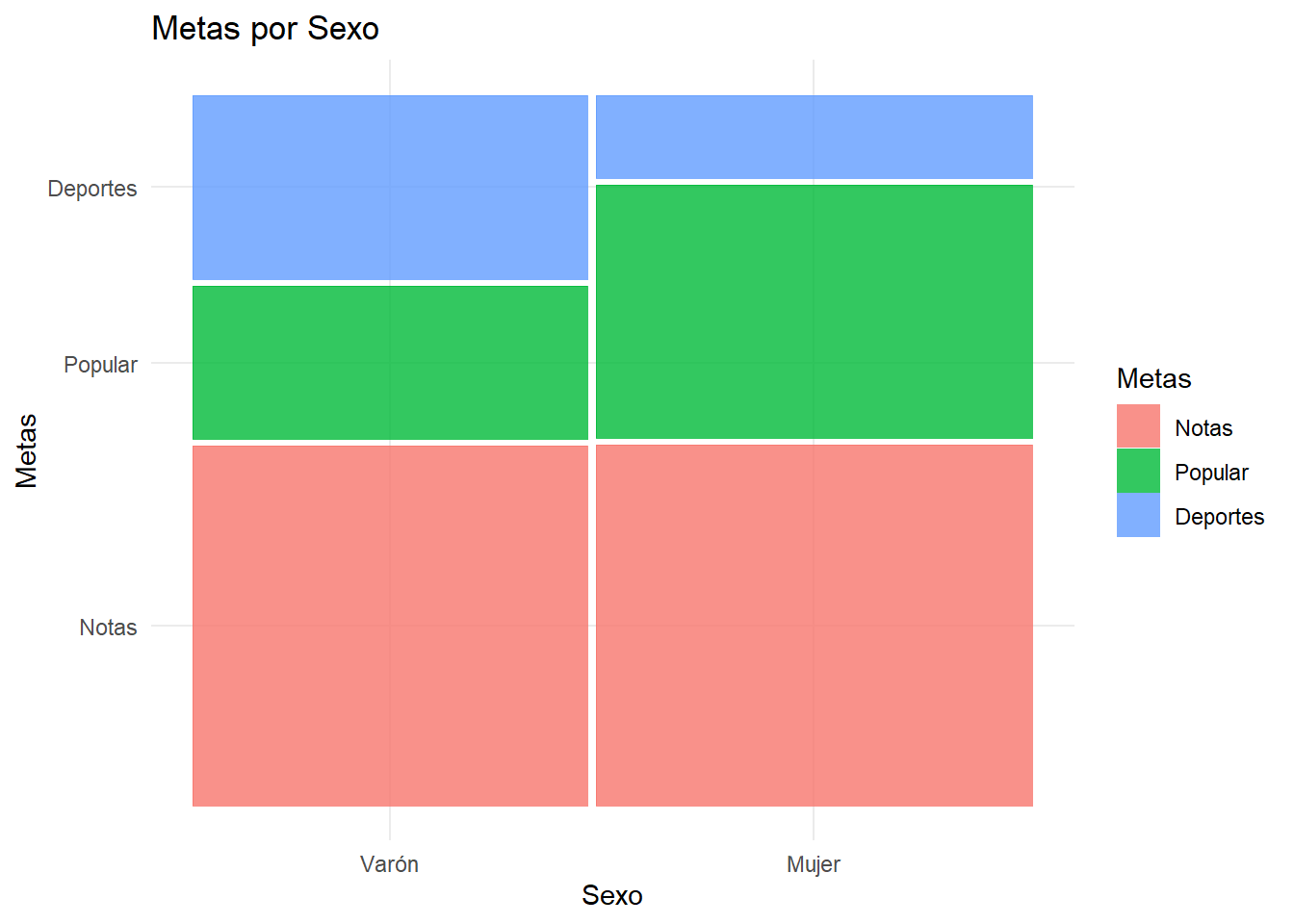

Con un poco de atención se observa porcentajes similares de niños y niñas en cuanto a la importancia que tienen para ellos las notas. Donde más diferencia se observa entre los sexos es en la preferencia que muestran muchos chicos por los deportes y muchas chicas por la popularidad.

Gráficamente podríamos mostrarlo con diagramas de barras apiladas:

ggbarstats(

data = df,

x = Metas,

y = Sexo,

title = "Distribución de Metas por Sexo",

label = "both"

)

Usando SPSS podemos conseguir tanto las frecuencias como los porcentajes y resultado de la prueba chi-cuadrado en el menú: “Analizar - Estadísticos descriptivos - Tablas de contingencia…”. Allí situamos en columnas la variable Sexo, y en filas ponemos Metas. En el botón Casillas marcamos los porcentajes por columnas. En el botón “Estadísticos…” para marcar seleccionamos la prueba chi-cuadrado de Pearson.

En Jamovi lo encontramos en el menú “Análisis - Recuento - Muestras independientes”. Allí situamos en columnas la variable Sexo, y en filas ponemos Metas. Abrimos el panel “Celdas”y marcamos “Porcentajes por columnas”.

6.1 Limitaciones de la prueba de independencia

El contraste de independencia tiene muy pocas limitaciones, aunque es conveniente hacer algunas observaciones:

Para contrastar la independencia se suele usar el estadístico chi-cuadrado de Pearson. Su cálculo se basa en calcular la diferencia entre las observaciones observadas para cada par de modalidades de las variables (casillas), y las que serían de esperar en caso de que se satisficiese la condición de independencia. Para que se pueda considerar correcta la significación calculada por el estadístico chi-cuadrado de Pearson, se debe cumplir que las frecuencias esperadas no sean muy pequeñas (inferiores a 5) más que en unas pocas casillas. Si es en muchas las casillas donde esto ocurre (más del 20% por ejemplo) se debe usar una prueba que no incluya aproximaciones, como la prueba exacta de Fisher. Esta la ofrece cualquier programa como opción cuando se hace este tipo de contrastes.

Si las muestras son muy grandes, la prueba de independencia dará resultados significativos incluso donde, posiblemente, consideremos que las diferencias no sean en realidad clínicamente interesantes. Es conveniente una inspección visual para confirmar si las diferencias observadas por filas (o columnas, como prefiramos), nos parecen de interés.

Si las variables poseen muchos niveles posiblemente la prueba no resulte de mucho interés, ya que es lógico esperar que se encuentren diferencias. Eso ocurre si por ejemplo una de las variables es numérica y no hemos agrupado los posibles valores en una cantidad adecuada de intervalos.

Si una de las variables es numérica u ordinal, posiblemente queramos hacer algo más que contrastar la simple independencia. Después de todo, esto no es tan informativo como saber que en cierto grupo los valores son significativamente mayores que en otro. Lo aconsejable es usar pruebas de tipo t-student, anova o contrastes no paramétricos comos los que se tratan en otros temas.

El contraste de chi-cuadrado sirve para contrastar la independencia. No hay que considerarla como una medida de la asociación entre variables. Si buscamos estudiar la asociación de variables tenemos otros métodos a nuestra disposición como regresión logística que trataremos más adelante.